Hpe, Schneider Electric, Rockwell Automation, Vertiv, Siemens, Sap, Lenovo, Cisco, Iliad, Advantech, ServiceNow, Fastweb, Audi, Mercedes: quasi ogni giorno vengono annunciate collaborazioni fa Nvidia e altri grandi brand, prevalentemente dell’area tech. E a noi di Industria Italiana non può che colpire che fra le partnership più recenti ci siano quelle con tre colossi dell’automazione, che è una nostra ragion d’essere: Siemens, Schneider Electric, Rockwell. Perché tutto questo fermento? Perché Nvidia ha una cosa che tutte queste imprese non hanno: le gpu. Questi chip sono fondamentali per accelerare i complessi calcoli relativi all’IA e a oggi l’azienda è leader in questo ambito. E oltre alle gpu propone altre soluzioni dell’azienda, come il metaverso industriale Nvidia Omniverse, i sistemi di supercalcolo Dgx che integrano sia hardware sia software, e molto altro.

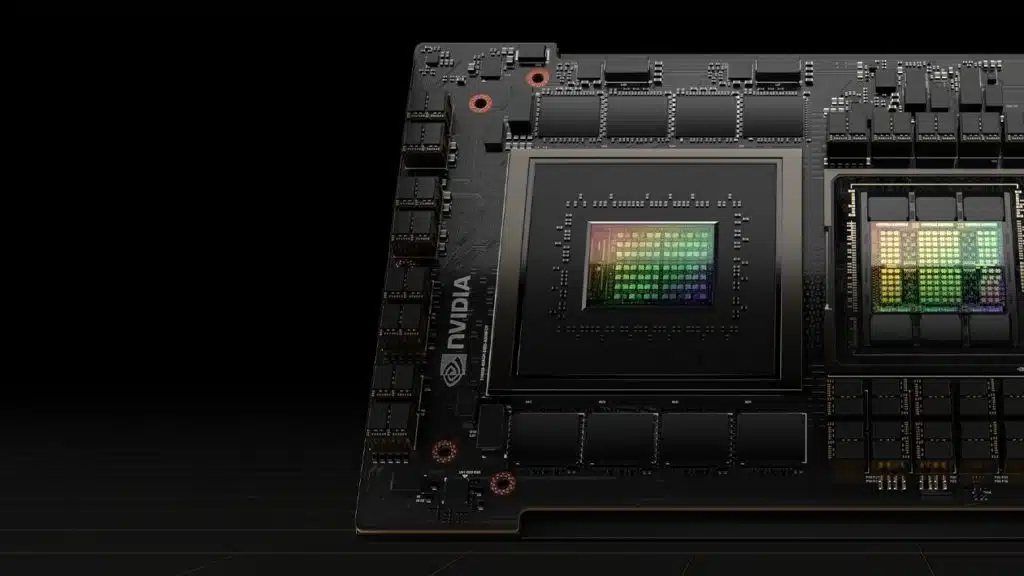

In pratica, oggi chi vuole mettere in piedi un’architettura di supercalcolo per l’IA ha pochissime alternative e Nvidia è la più gettonata. Perché è arrivata prima di tutti a capire che puntare su questa tecnologia era la strada giusta, trovandosi ora ad avere un enorme vantaggio competitivo sui concorrenti, che faticano a rendere disponibili soluzioni altrettanto potenti e valide. Di qui le numerose partnership con grandi aziende, che fanno letteralmente a gara per assicurarsi le gpu. Tantissime gpu. Basti pensare che Meta ha annunciato che entro la fine dell’anno acquisterà 350.000 gpu Nvidia H100. Un investimento miliardario, considerato che ciascuno costa qualcosa come 30.000 dollari. Imprese come Siemens e Aveva si appoggiano a Nvidia per sviluppare i loro metaversi industriali, mentre Lenovo e Hpe necessitano delle gpu per mettere in piedi sistemi evoluti per l’addestramento e l’inferenza IA. Fra i clienti anche Microsoft, Google e Aws, hyperscaler che offrono piattaforme e infrastrutture per l’IA ai loro clienti, infrastrutture che si basano fortemente sull’hardware Nvidia, nonostante Aws abbia sviluppato internamente chip similari.

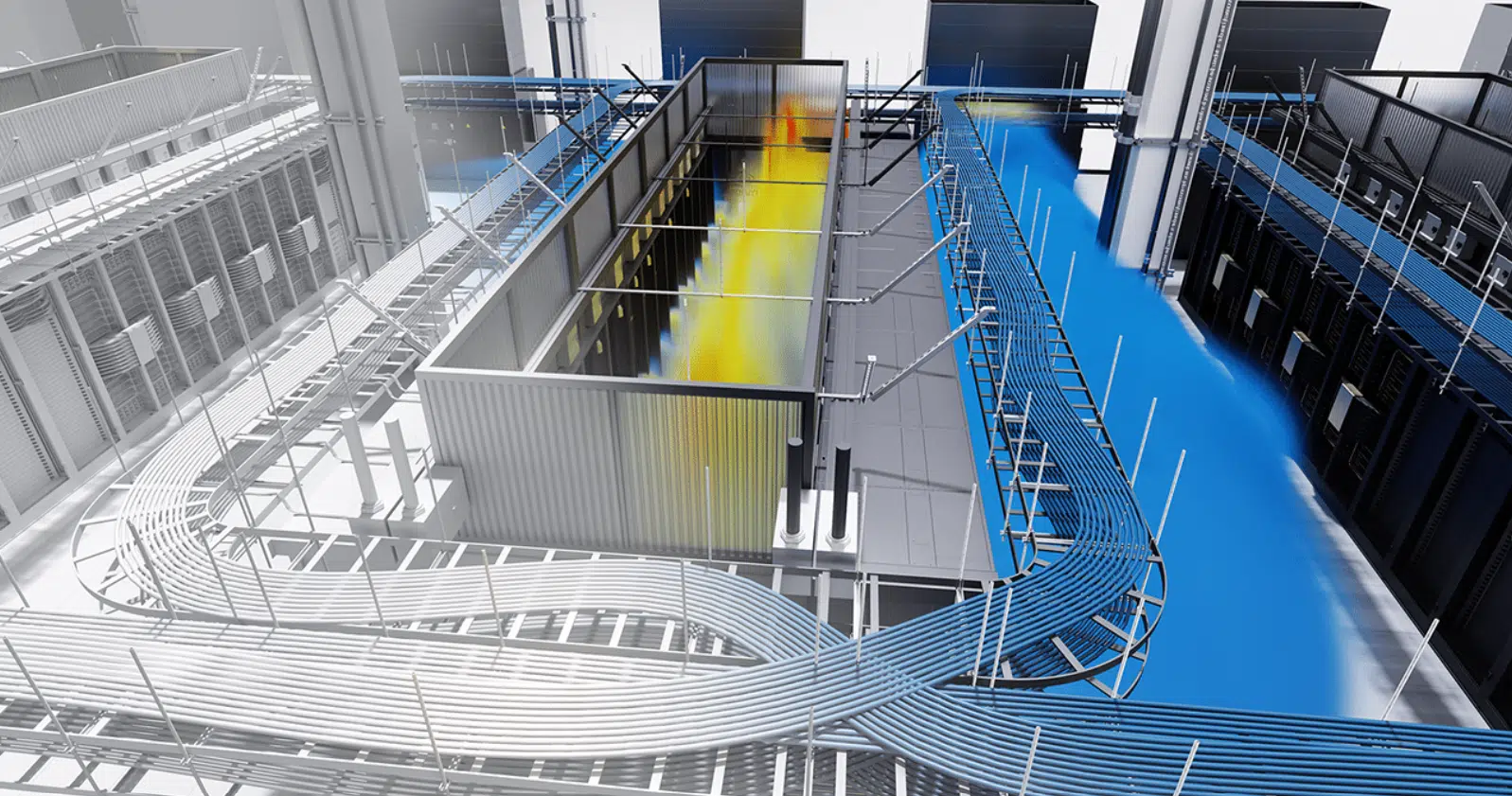

Infine, c’è un altro aspetto da sottolineare: questi chip sono assetati di energia, e scaldano parecchio. Così tanto che i data center attuali a breve non saranno più in grado di gestire il carico. Di qui le partnership con Schneider Electric e Vertiv, che stanno lavorando insieme a Nvidia per rivedere il design dei centri di calcolo, ottimizzandoli per le future architetture di IA, anche in ottica di una maggiore sostenibilità.

Automazione e IA vanno a braccetto: la collaborazione fra Rockwell Automation e Nvidia

A marzo 2024 Rockwell Automation ha annunciato di aver stretto una partnership con Nvidia finalizzata ad accelerare un’architettura industriale di nuova generazione. In cosa consiste? Rockwell integrerà ulteriormente le interfacce di programmazione delle applicazioni (le Api) di Nnvidia Omniverse Cloud con Emulate3D di Rockwell, offrendo agli utenti interoperabilità dei dati, collaborazione in tempo reale e visualizzazione su base fisica per progettare, costruire e gestire gemelli digitali dei sistemi di produzione, su scala industriale. A seguito dell’acquisizione di Otto Motors, inoltre, Rockwell sta sviluppando sulla piattaforma robotica Nvidia per l’edge AI, contribuendo così a portare Amr e applicazioni di automazione di processo ai clienti industriali. A seguito della collaborazione, inoltre, Nvidia è diventata membro ufficiale del Rockwell Automation PartnerNetwork: i clienti di Rockwell possono ora utilizzare le applicazioni Nvidia per contribuire a rendere le loro operazioni più resilienti, agili e sostenibili.

Nvidia e Siemens insieme per il metaverso industriale

Il metaverso doveva essere la tecnologia che avrebbe rivoluzionato il mondo, almeno nelle intenzioni di Mark Zucherberg, il fondatore di Meta, che ci ha scommesso 10 miliardi. Una scommessa che, se ancora non è persa, è comunque stata notevolmente ridimensionata: la realtà virtuale, fatta eccezione per specifici ambiti, non ha conquistato gli utenti. E nel frattempo è uscito ChatGpt, che ha dato il via agli investimenti sull’IA. Questo non significa che il metaverso sia morto, anzi: Siemens spinge molto sulla sua idea di metaverso industriale, e lo sta realizzando proprio insieme a Nvidia, portando il computing accelerato, l’intelligenza artificiale generativa e l’integrazione di Omniverse in tutto il portafoglio Siemens Xcelerator.

Siemens spinge molto sulla sua idea di metaverso industriale, e lo sta realizzando proprio insieme a Nvidia, portando il computing accelerato, l’intelligenza artificiale generativa e l’integrazione di Omniverse in tutto il portafoglio Siemens Xcelerator

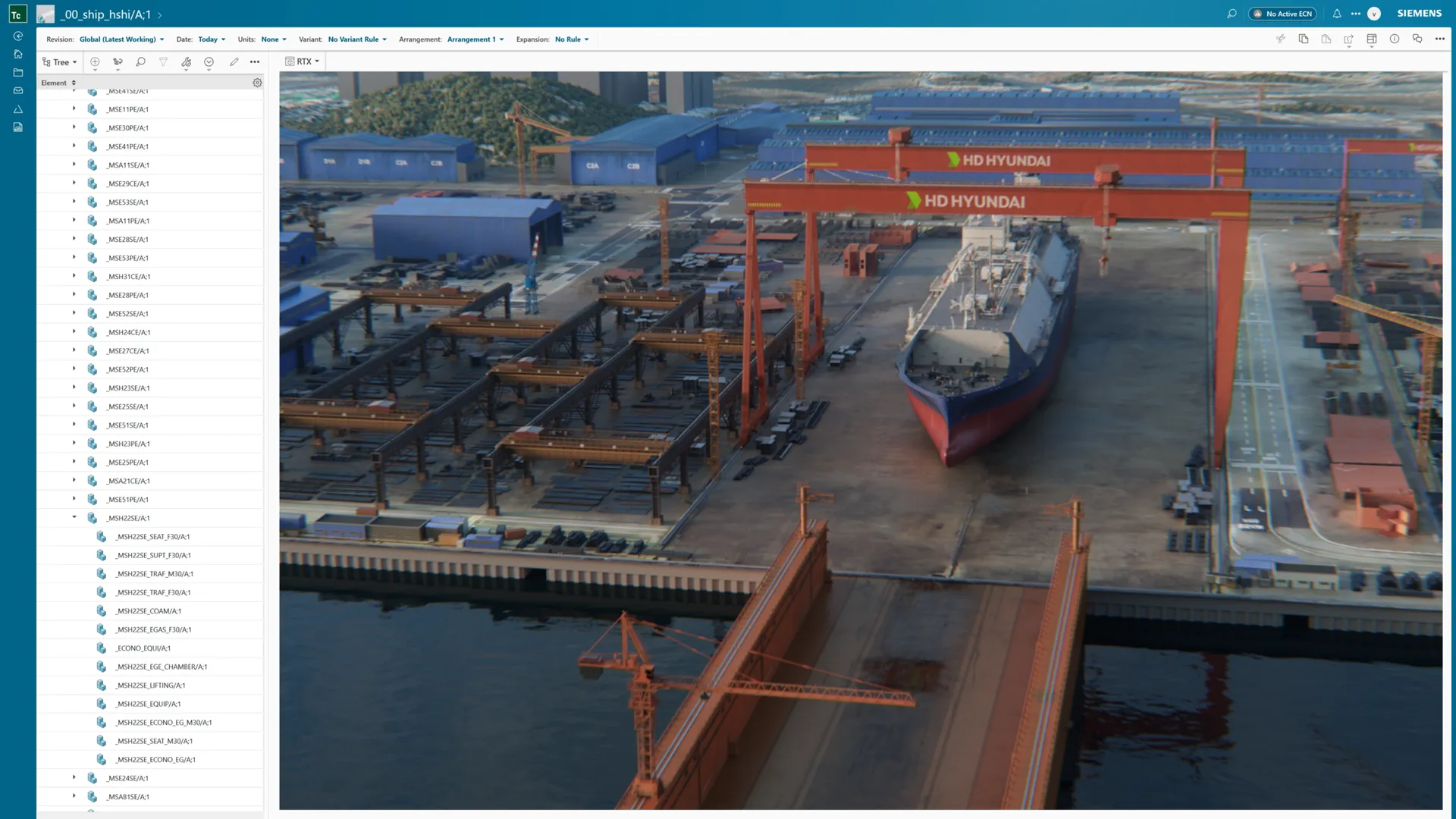

Quest’anno Siemens renderà disponibile Teamcenter X, che offrirà ai team di progettazione la possibilità di creare un gemello digitale ultra-intuitivo, fotorealistico, in tempo reale e basato sulla logica che elimina gli sprechi e gli errori del flusso di lavoro. L’impostazione e la regolazione dei dettagli nei rendering fotorealistici, come le definizioni dei materiali e gli ambienti di illuminazione, insieme ad altre risorse scenografiche di supporto, saranno notevolmente accelerate dall’IA generativa. Compiti che prima richiedevano giorni adesso possono essere completati in poche ore, con i dati di progettazione contestualizzati come apparirebbero nel mondo reale. Oltre all’ingegneria, anche altre parti interessate, dai team di vendita e marketing ai decision-maker e ai clienti, beneficeranno di una visione e di una comprensione più approfondite dell’aspetto reale dei prodotti, consentendo di prendere decisioni più consapevoli e rapide.

Un esempio pratico della collaborazione fra Siemens e Nvidia è il caso HD Hyundai, realtà specializzata nella produzione di navi sostenibili che sta sviluppando navi alimentate ad ammoniaca e idrogeno, un processo complesso che richiede la supervisione di navi che possono contenere oltre sette milioni di parti distinte. HD Hyundai utilizza Teamcenter X per unificare e visualizzare in modo interattivo questi enormi set di dati ingegneristici.

Schneider e Nvidia uniscono le forze per nuovi data center dedicati all’IA

I calcoli per l’IA, come già detto, sono particolarmente pesanti dal punto di vista computazionale e, di conseguenza, anche sotto il profilo dei consumi energetici. Questo significa più energia elettrica utilizzata e, inevitabilmente, una maggior quantità di calore da smaltire. Così tanto che le soluzioni tradizionali ad aria stanno iniziando a diventare insufficienti, fatto che sta spingendo aziende come Schneider Electric a investire sulla ricerca di nuovi e più efficaci sistemi di raffreddamento a liquido. Secondo Schneider non saranno solamente i rack a dover essere aggiornati, ma interi data center, che dovranno venire riprogettati completamente per poter smaltire l’enorme calore generato dalle migliaia di server al loro interno. Anche la parte di distribuzione elettrica andrà ripensata, perché gli attuali armadi a breve non saranno più in grado di sopportare l’enorme quantità di energia richiesta dai workload di IA. Non si tratta di piccole modifiche, ma proprio di ripensare l’attuale approccio alla costruzione dei data center. Il tutto tenendo anche conto della sostenibilità ambientale, un tema molto caro a tutta l’industria Ict.

Schneider ha quindi stretto una collaborazione con Nvidia per presentare nuovi reference design per data center all’avanguardia, creati su misura per i cluster di accelerated computing Nvidia e realizzati per l’elaborazione dei dati, la simulazione ingegneristica, l’automazione della progettazione elettronica, la progettazione farmacologica assistita da computer e l’intelligenza artificiale generativa. Un’attenzione particolare sarà rivolta all’abilitare la distribuzione ad alta potenza, sistemi di liquid cooling e strumenti di controllo che assicurino una messa in opera semplificata e affidabilità nel funzionamento dei cluster ad estrema densità.

La collaborazione fra Schneider Electric e Nvidia non si limita a questo. La controllata Aveva, infatti, impresa specializzata nella simulazione ingegneristica, collegherà la sua piattaforma di digital twin a Nvidia Omniverse così da offrire un ambiente unificato per la simulazione e la collaborazione virtuale. Un’integrazione che secondo la multinazionale favorirà la collaborazione tra progettisti, ingegneri e altri attori coinvolti, accelerando la progettazione e l’implementazione di sistemi complessi e contribuendo a ridurre il time-to-market e i costi.

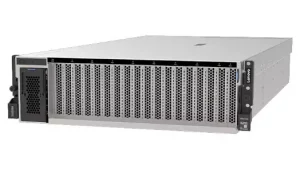

Ict: le partnership di Nvidia con Lenovo e Hpe

I server di Lenovo sono utilizzati in svariati ambiti, dall’industria alla sanità, dalla Pubblica Amministrazione ai motorsport (la multinazionale è partner e main sponsor del tema Ducati di Moto GP). Il colosso ha subito compreso l’impatto che avrebbe avuto l’IA e ha subito stretto accordi con Nvidia per offrire nuove soluzioni ai propri clienti, tanto che oggi Lenovo è il principale fornitore di supporto workstation-to-cloud per la progettazione, l’ingegnerizzazione e l’alimentazione di Nvidia Ocv e Nvidia Omniverse. Per aiutare le aziende a creare e distribuire rapidamente un’ampia gamma di applicazioni di AI, Hpc e omniverse progettate ad hoc, Lenovo collabora con Nvidia per realizzare più rapidamente modelli accelerati utilizzando l’architettura di riferimento modulare Nvidia Mgx. Grazie a questo design, i provider di servizi cloud possono acquisire più rapidamente modelli personalizzati e quindi sono in grado di offrire un computing accelerato per l’IA e per i carichi di lavoro omniverse a costi contenuti e su larga scala. Grazie al supporto time-to-market di Nvidia H200, i sistemi permetteranno a scienziati e ricercatori di affrontare le sfide scientifiche globali accelerando le applicazioni AI e HPC complesse che eseguono terabyte di dati.

Le tecnologie di Lenovo e Nvidia basate sull’intelligenza artificiale e sull’infrastruttura Lenovo permettono ai clienti di velocizzare la trasformazione digitale e di sfruttare nuove opportunità in tutti i settori di mercato. Nel retail, le soluzioni di Lenovo e Nvidia monitorano i movimenti e i comportamenti dei clienti per ottimizzare il flusso del traffico e controllare meglio l’inventario in tempo reale. Nel manifatturiero, le soluzioni integrate di Lenovo e Nvidia contribuiscono a migliorare la sicurezza di dipendenti e macchinari affinando i processi di ispezione delle catene di montaggio. Nelle città, le soluzioni integrate Lenovo Edge AI consentono di trarre il meglio dai dati migliorando l’uso di spazi, infrastrutture e risorse per assistere i cittadini in caso di congestione del traffico e ridurre il consumo energetico.

Anche Hpe è da tempo un importante partner di Nvidia. La multinazionale guidata da Antonio Neri collabora da tempo con il produttore di Gpu e ha recentemente potenziato il proprio portafoglio di soluzioni AI-native. Fra queste, un supercomputer progettato per svolgere calcoli relativi alla GenAI e al deep learning che supporta fino a 168 Nvidia GH200 Grace Hopper Superchip. Un hpc che consente alle grandi imprese, agli istituti di ricerca e agli enti governativi di semplificare il processo di sviluppo dei modelli con uno stack di software AI/ML che aiuta i clienti ad accelerare i progetti di GenAI e deep learning, fra cui Llm, sistemi che forniscono una raccomandazione come output e database vettoriali. Fornita con servizi di installazione e configurazione, questa soluzione “chiavi in mano” è progettata per essere utilizzata nei centri di ricerca sull’IA e nelle grandi aziende per migliorare il time-to-value e accelerare il training di 2-3 volte.

A Discover Barcelona 2023 Hpe ha presentato una nuova soluzione co-progettata con Nvidia. Un cluster di calcolo per l’IA ad alte prestazioni e al software di Hpe e di Nvidia pensato per il fine-tuning leggero dei modelli di IA, la RAG e l’inferenza fornita con architettura scale-out. Il sistema è basato sui server Hpe ProLiant DL380a Gen11 e preconfigurata con le Gpu Nvidia, la piattaforma di rete Nvidia Spectrum-X Ethernet e le Dpu Nvidia BlueField-3. Fra i software utilizzati, Nvidia AI Enterprise 5.0 con il nuovo microservizio Nvidia Nim per l’inferenza ottimizzata di modelli generativi di intelligenza artificiale, e Nvidia NeMo Retriever e ad altre librerie di data science e IA.

Le tlc puntano sull’IA: le partnerhip di Nvidia con Iliad e Fastweb

Le tlc stanno cambiando il loro modello di business. Non si ragiona più sulla quantità di dati, ma su Sla (Service level agreement) personalizzati e servizi aggiunti. Inclusi quelli di supercalcolo e di IA. Come sta facendo Iliad, che a settembre 2023 ha annunciato l’acquisizione di un supercomputer Nvidia Dgx SuperPOD, che a oggi viene considerata la piattaforma di IA più avanzata sul mercato.

Un investimento che rappresenta un primo passo per raggiungere l’obiettivo a breve termine di aumentare la potenza di calcolo cloud-native disponibile all’interno delle strutture di Scaleway, società controllata da Iliad e attiva nel settore del cloud computing. Parallelamente ha anche avviato un investimento da 100 milioni di euro per la creazione di un laboratorio di eccellenza sull’intelligenza artificiale che ha l’obiettivo di aiutare l’intero ecosistema AI (organizzazioni pubbliche e private, imprese e organizzazioni no profit) a beneficiare di progressi nello sviluppo e nell’ottimizzazione di modelli di IA, ma anche di formare una nuova generazione di ricercatori e di promuovere la consapevolezza delle istituzioni, delle aziende e del pubblico in generale sulle tecnologie dell’IA.

Fastweb non ha voluto essere da meno: ha infatti acquisito un sistema composto da 31 gpu Nvidia Dgx H100 basato sull’architettura Nvidia Dgx SuperPod ed equipaggiato con ben 248 gpu H100. L’idea è quello di metterlo a disposizione di aziende, università, Pubbliche Amministrazioni in cloud in modalità IaaS (Infrastructure as a service) per lo sviluppo di servizi ed applicazioni AI e Gen AI. Ma non è l’unico progetto a cui è destinato l’investimento: grazie a questo supercomputer e alla suite Nvidia AI Enterprise Fastweb realizzerà il primo Large language model addestrato in lingua italiana. Un Llm “nazionale”, come lo definisce l’azienda, che sarà in grado di funzionare da piattaforma per lo sviluppo, sia da parte di Fastweb che di terzi, di un ampio range di applicazioni di GenAI, catturando sfumature della lingua italiana, della sua grammatica, del contesto e della specificità culturale nazionale.

Nvidia e gli hyperscaler

Uno dei big player dell’IA è Microsoft, che ha investito oltre 10 miliardi su OpenAI, l’azienda che ha dato il via alla rivoluzione della GenAI con ChatGpt e Dall-E. Anche la casa di Redmond collabora con Nvidia e di recente ha annunciato una partnership relativa ai chip Grace Blackwell 200 Superchip per i modelli AI di prossima generazione. GB200 è un nuovo processore progettato specificamente per carichi di lavoro di IA generativa su larga scala, elaborazione dei dati e carichi di lavoro ad alte prestazioni, con una larghezza di banda della memoria fino a un massiccio 16 TB/s e fino a un’interferenza stimata 45 volte sui modelli con un trilione di parametri rispetto alla precedente generazione di server Hopper. Microsoft ha lavorato a stretto contatto con Nvidia per garantire che le Gpu, compresa la GB200, possano gestire i più recenti modelli di linguaggio di grandi dimensioni addestrati sull’infrastruttura Azure AI.

E implementerà un’architettura di calcolo IA end-to-end che fa leva sulla soluzione per il networking InfiniBand Nvidia Quantum-X800. Vale la pena di sottolineare che Azure sarà il primo hyperscaler a supportare istanze di calcolo basate sui nuovi chip B200, che promettono di essere i più potenti mai sviluppati per questo tipo di applicazioni.

Ma Azure non sarà l’unica azienda ad utilizzare i chip GB200. Alimenteranno anche i sistemi di elaborazione di Google Cloud. E anche di AWS. Il cloud Aws è stato uno dei primi a offrire strumenti per applicazioni di intelligenza artificiale e il colosso già oggi supporta i carichi di lavoro IA di svariate aziende a livello globale. L’azienda fondata da Jeff Bezos ha anche sviluppato internamente dei chip per accelerare i calcoli relativi all’IA, gli Inferentia e i Trainium 2, dedicati rispettivamente all’inferenza e all’addestramento dei modelli di IA. Eppure, nonostante le enormi competenze interne, anche Aws non può fare a meno di collaborare con Nvidia.

Le collaborazioni di Nvida con i big dell’automotive

L’automotive si sta trasformando radicalmente con l’elettrico. Una trasformazione avviata da Tesla, che non ha solo creato l’auto elettrica di maggior successo sul mercato, ma ha proprio ripensato il concetto di automobile. La meccanica non è più centrale e il cuore dei progetti diventa il software, che abilita le funzionalità della vettura la gestione delle ricariche, gli Adas e anche l’azionamento di dispositivi banali come i tergicristalli. E, soprattutto, le funzionalità di guida autonoma, che nei prossimi anni diventeranno sempre più importanti. Tesla sotto questo profilo è molto avanti, ma la concorrenza si sta facendo agguerrita.

Mercedes, per esempio, ha stretto una collaborazione con l’azienda guidata da Jensen Huang per creare un sistema di calcolo in-vehicle e un’infrastruttura di calcolo IA che questo sarà implementato in tutta la flotta di veicoli Mercedes-Benz di nuova generazione, dotandoli di funzioni di guida automatizzata aggiornabili. L’obiettivo è ambizioso: le due aziende infatti puntano a sviluppare l’architettura di calcolo più sofisticata e avanzata mai implementata in un’automobile. Un’architettura definita dal software che sarà costruita sulla piattaforma Nvidia Drive e sarà standard nella flotta di nuova generazione di Mercedes-Benz, consentendo funzionalità di guida automatizzata all’avanguardia. Una caratteristica principale sarà la capacità di automatizzare la guida di percorsi regolari da indirizzo a indirizzo. Inoltre, ci saranno numerose future applicazioni di sicurezza e convenienza. I clienti potranno acquistare e aggiungere capacità, applicazioni software e servizi in abbonamento tramite aggiornamenti software over-the-air durante la vita dell’auto.

Anche Bmw sta lavorando insieme a Nvidia per trasformare il ciclo di vita della produzione automobilistica. In questo caso, realizzando gemelli digitali simulati e abilitati all’IA della fabbrica Bmw. E non può mancare Audi fra i top player. Già dal 2017, infatti, la casa tedesca sta collaborando con Nvidia per dotare le proprie auto di sistema di guida autonoma evoluti.

Anche Leapmotor, carmaker cinese partecipato al 20% da Stellantis (che ci ha investito 1,5 miliardi) ha ottimi rapporti con Nvidia: il prossimo suv dell’azienda, infatti, sarà equipaggiato coi più potenti chip di Qualcomm e, ovviamente, di Nvidia.

E non è finita qui…

Abbiamo citato le principali collaborazioni potenziate o recentemente avviate da Nvidia con aziende operanti in svariati settori. Ma la lista è molto lunga, e destinata ad ampliarsi. L’hardware e il software di Nvidia supporteranno le funzionalità di GenAI integrate in Sap; GE Healthcare ha scelto le soluzioni di Nvidia per l’analisi delle immagini medicali tramite IA; Johnson & Johnson lavora con l’azienda per portare l’IA nel mondo della chirurgia. E ancora possiamo citare Byd Mellon, banca che ha scelto di dotarsi del supercomputer Dgx SuperPop equipaggiato con gpu Dgx H100, e ServiceNow, che si appoggia all’hardware Nvidia nella sua soluzione , Now Assist for Telecommunications Service Management.

Chi è Nvidia?

Nvidia nasce come produttore di schede video (gpu) dedicate ai videgiocatori. Parliamo della fine degli Anni ’90, quando l’azienda entra in competizione con l’allore leader del settore, 3Dfx, realtà che acquisirà pochi anni dopo per rilevarne tecnologie e competenze. Non realizza direttamente i chip: ne cura il progetto e poi si affida a Tsmc per la produzione di larga scala (e lo fa tuttora). A lungo il pubblico di riferimento dell’azienda è stato composto quasi esclusivamente da videogiocatori e professionisti della grafica 3D, che utilizzavano gli acceleratori di Nvidia per velocizzare le operazioni di modellazione 3D e il rendering. Col tempo però le gpu iniziano a fare concorrenza ai processori generici, quelli prodotti da Intel e Amd, tanto da iniziare a sostituirli anche in ambiti molto specifici, come gli hpc, le infrastrutture per il supercalcolo. Queste schede sono tanto veloci che vengono presto utilizzate anche per altri scopi, a partire dal mining delle criptovalute, un affare che ha portato Nvidia gioie e dolori. Con l’esplosione del fenomeno bitcoin, infatti, i miner hanno fatto incetta delle schede video Nvidia, le più efficienti per questo tipo di calcoli, rendendole praticamente introvabili sul mercato oltre che carissime. La svolta più significativa, però, arriva nel 2023. ChatGpt è stato reso pubblico da pochi mesi, dando via al fenomeno dell’IA generativa, e numerosissime aziende hanno iniziato a lavorare su soluzioni di IA, creando i propri Large language model, addestrando i propri modelli effettuando i calcoli relativi all’inferenza dell’IA. Calcoli che non possono essere affrontati sui processori generici, ma richiedono acceleratori specifici. E Nvidia, che li sviluppa, vede il valore delle proprie azioni crescere vertiginosamente.