di Marco Scotti ♦ Nuovo software cloud da Big Blue, che punta sempre di più su quella che chiama A.I. (Augmented Intelligence), nell’ambito di Watson. Così l’azienda guidata da Ginni Rometty vuole consolidare il suo primato

Controllare l’intelligenza artificiale, verificare i processi decisionali ed evitare possibili errori che potrebbero compromettere il business. È questa l’idea che ha portato Ibm a realizzare una nuova tecnologia per la trasparenza dell’intelligenza artificiale. Si tratta di un software cloud che consente di riconoscere le eventuali distorsioni e che spiega in che modo l’intelligenza artificiale prende decisioni. «Il tema generale – spiega a Industria Italiana Pietro Leo, Executive Architect IBM Italia – è quello di rendere disponibili degli strumenti di intelligenza artificiale che ci aiutino a verificare che i sistemi funzionino bene. Sono dei sistemi che coadiuvano nel controllo di altri sistemi. Il che ci porta a una domanda: perché l’intelligenza artificiale ha bisogno di controllo? Dove espone il fianco?

«I moduli di Ai sono percepiti come se fossero delle black box, in particolare quei sotto-sistemi, sviluppatisi negli ultimi anni, che vengono chiamati deep-learning o reti neurali. Tradotto, significa che questi sistemi vengono addestrati sulla base di esempi che forniamo noi umani in modo che centinaia di migliaia di esempi vengano mostrati all’algoritmo, che può così arrivare a “definire” un determinato concetto. Ma è proprio qui che si nasconde “il diavolo”: se ho fornito i dati in modo esaustivo sono sicuro che la capacità predittiva dell’algoritmo sarà estremamente accurata. Però se non dovessi fare così, generei automaticamente dei “bias” (ovvero dei pregiudizi) che potrebbero far commettere all’intelligenza artificiale degli errori. Ovviamente il problema non è dell’algoritmo, ma di chi lo programma».

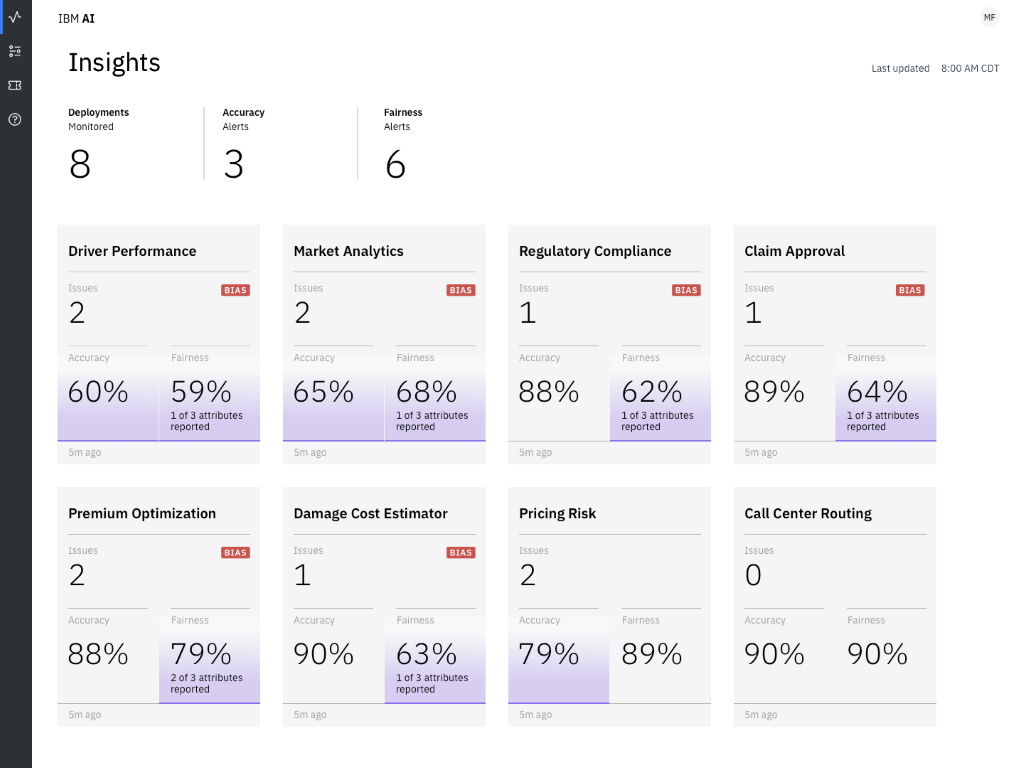

Un altro dettaglio importante è rappresentato dal fatto che il nuovo sistema di monitoraggio raccomanda – in maniera autonoma – i dati da aggiungere al modello per minimizzare le distorsioni. L’interfaccia con l’utente avviene in un linguaggio di facile comprensione anche per i non addetti ai lavori, mostrando chiaramente quali fattori hanno fatto propendere l’Ai verso l’una o l’altra decisione. Inoltre, viene tenuta traccia dei fattori, delle performance e delle modalità di gestione del sistema di intelligenza artificiale. E possono essere facilmente richiamati per motivi regolatori, come nel caso della GDPR.

Osservare l’intelligenza artificiale

«Forniamo – ci spiega ancora Leo – ulteriori algoritmi che cercano di analizzare in anticipo delle indicazioni sul database: se è sbilanciato, se ha dei parametri sovradimensionati. Questo servizio che offriamo in cloud è un servizio a cui può assistere chiunque in fase preparatoria per fare un’analisi dei bias possibili. Ma l’algoritmo che abbiamo implementato funziona anche in tempo reale, ovvero è in grado di segnalare dove e come sta andando l’addestramento». In questo modo, le imprese potranno “guardare” dentro i sistemi di intelligenza artificiale attraverso una dashboard che consentirà anche di prevedere aggiustamenti automatici, aumentando la visibilità sui risultati finali ed evitando esiti potenzialmente dannosi per il business.

«Ibm – ha detto David Kenny, uno dei “papà” di questo nuovo sistema – sta guidando l’intera filiera industriale nell’utilizzare fiducia e trasparenza come principi cardine per lo sviluppo delle nuove tecnologie di intelligenza artificiale. È giunto il momento di tradurre i principi in pratica. Stiamo offrendo nuove soluzioni a tutti coloro che utilizzano l’intelligenza artificiale e che avrebbero maggiori ripercussioni dannose in caso di un decision making errato». La nuova offerta realizzata da Ibm per il suo Cloud è nata grazie allo sviluppo di modelli provenienti da un gran numero di framework di machine learning come Watson, SparkMl, Aws SageMaker e AzureMl. Questo significa che le imprese possono avvantaggiarsi di una serie di controlli che provengono da alcuni dei più importanti modelli di intelligenza artificiale utilizzati dalle aziende. Il servizio software può anche essere programmato per monitorare le singole decisioni o processi, dal momento che può essere totalmente profilato sulle esigenze dell’azienda.

I servizi offerti

«Il nostro nuovo prodotto – ci racconta Leo – permette di essere impiegato da chiunque sviluppi framework in deep-learning. Il programmatore di Ai può decidere di utilizzare questi servizi per fare validazioni. Il primo check avviene sulla qualità del dato in sé, se è sufficientemente significativo da sostenere un buon risultato finale. Inoltre, aiuta a spiegare il ragionamento che l’algoritmo utilizza per elaborare la propria decisione. Gli algoritmi di deep learning funzionano benissimo, ma quando si tratta di comprendere le motivazioni di base diventano un po’ più complessi. Il terzo servizio che offriamo è quello della dashboard, che spiega tutto non solo in un linguaggio comprensibile al data scientist che svolge programmazione, ma anche per l’utente business che impiega il sistema finale».

Chi ha paura dell’AI?

Questi sviluppi si sommano alla nuova ricerca portata avanti dall’Institute for Business Value di Ibm, che rivela che mentre l’82% delle imprese stanno considerando uno sviluppo delle tecnologie legate all’intelligenza artificiale, il 60% teme problemi di affidabilità e il 63% percepisce una carenza di risorse umane che possano gestire in maniera adeguata questo tipo di tecnologia. Dalla survey, condotta su oltre 5.000 manager, emerge un significativo ripensamento della relazione con l’intelligenza artificiale da parte degli executive. In particolare, gli amministratori delegati rilevano l’enorme importanza dell’adozione dell’intelligenza artificiale nell’IT, nella sicurezza delle informazioni, nell’innovazione, nel risk management e perfino nella relazione con i clienti. L’adozione dell’intelligenza artificiale, inoltre, sembra più significativa per accelerare il business in alcuni specifici comparti, come nel caso dei servizi finanziari.

«Dal punto di vista ingegneristico – aggiunge Leo – il nostro è un primo passo. C’è un enorme problema culturale: si ha paura dell’intelligenza artificiale perché non svolge più dei lavori meccanici e facilmente pronosticabili, ma compie ragionamenti incerti. L’accettazione di come viene fatto un sistema diventa così complesso. Per quanto riguarda il futuro dell’intelligenza artificiale, possiamo dire che c’è una prospettiva di lunghissimo periodo. Verranno sicuramente sviluppati ulteriori strumenti. Ma, almeno per ora, rimarrà una certa paura che ci venga portato via il lavoro. Un timore che coinvolge non soltanto l’Ai, ma anche la robotica, la meccanizzazione e tutte le altre innovazioni tecnologiche. L’intelligenza artificiale non è altro che una serie di algoritmi informatici che stanno dando un contributo significativo ed effettivo. La parola d’ordine è fiducia. E questa, per ora, manca».

Nuovi servizi di consulenza

Ibm, inoltre, sta rendendo disponibili nuovi servizi di consulenza che guidino le aziende a disegnare i propri processi di business e l’interazione uomo-macchina in modo da minimizzare qualsiasi stortura durante il processo decisionale. La ricerca Ibm ha messo a disposizione della comunità un toolkit, Ai Fairness 360, un’intera library di algoritmi, codici e tutorial che offrono agli accademici, ai ricercatori e ai data scientist gli strumenti e la conoscenza per limitare le problematiche durante la creazione e l’implementazione di moduli di intelligenza artificiale. Mentre altre soluzioni open source si sono concentrate esclusivamente nel ridurre le problematiche durante l’inserimento dei dati, il toolkit di Ibm permetterà di tenere conto di ogni interazione lungo tutta la filiera di creazione del modulo di intelligenza artificiale. È un invito alla comunità a una cooperazione che consenta di migliorare la conoscenza della tecnologia e di ridurre i problemi.

«Oltre all’annuncio di questi strumenti – conclude Leo – abbiamo anticipato già qualche settimana fa il lancio di Ibm Fairness 360°, che ci consente di mettere a disposizione di tutti gli strumenti necessari per “istruire” l’intelligenza artificiale. Al contempo, stiamo facendo una sorta di donazione scientifica che permette di sfruttare i modelli di intelligenza artificiale già implementati. In questa libreria ci sono una dozzina di algoritmi sviluppati da ricercatori di varie università nel mondo. Stiamo creando le basi di una comunità aperta, che affronti il problema dell’intelligenza artificiale in modo ingegneristico».